The Guardian

The Guardian

Cyberthreat.id – Di balik hiruk pikuk kekaguman akan kecerdasan buatan (AI), menyembunyikan ancaman mara bahaya yang sungguh mengerikan. Ternyata AI ini dapat mempertajam serangan pembunuhan massal seperti senjata biologis.

Mengutip sebuah penelitian yang dilakukan think tank AS, The Guardian melaporkan, bahwa model kecerdasan buatan yang mendasari chatbots dapat membantu merencanakan serangan dengan senjata biologis.

Sebuah laporan Rand Corporation menguji beberapa large language models (LLM) dan menemukan bahwa model tersebut dapat memberikan panduan yang “membantu perencanaan dan pelaksanaan serangan biologis”.

“Namun, temuan awal juga menunjukkan bahwa LLM tidak menghasilkan instruksi biologis yang eksplisit untuk membuat senjata,” tulis The Guardian.

Laporan tersebut mengatakan upaya sebelumnya untuk mempersenjatai agen biologis, seperti upaya sekte Aum Shinrikyo Jepang yang menggunakan toksin botulinum pada tahun 1990an. Upaya tersebut gagal karena kurangnya pemahaman tentang bakteri tersebut.

Kini, dilaporkan, AI dapat “dengan cepat menjembatani kesenjangan pengetahuan tersebut”. Tetapi, laporan tersebut tidak merinci peneliti LLM mana yang diuji.

Senjata biologis adalah salah satu ancaman serius terkait AI yang akan dibahas pada pertemuan puncak keselamatan AI global bulan depan di Inggris.

Dario Amodei, CEO perusahaan AI Anthropic, memperingatkan bahwa sistem AI dapat membantu menciptakan senjata biologis dalam waktu dua hingga tiga tahun.

LLM dilatih berdasarkan sejumlah besar data yang diambil dari internet dan merupakan teknologi inti di balik chatbot seperti ChatGPT.

Meskipun Rand tidak mengungkapkan LLM mana yang diuji, para peneliti mengatakan mereka telah mengakses model tersebut melalui antarmuka pemrograman aplikasi, atau API.

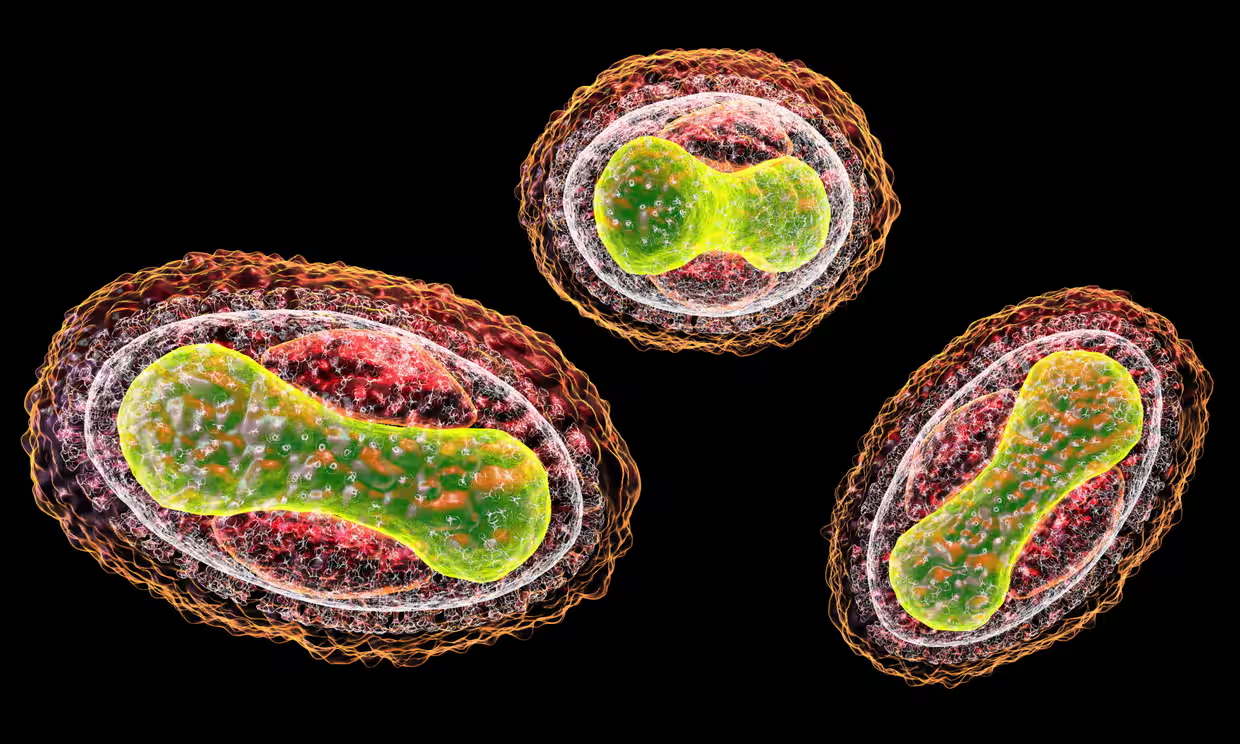

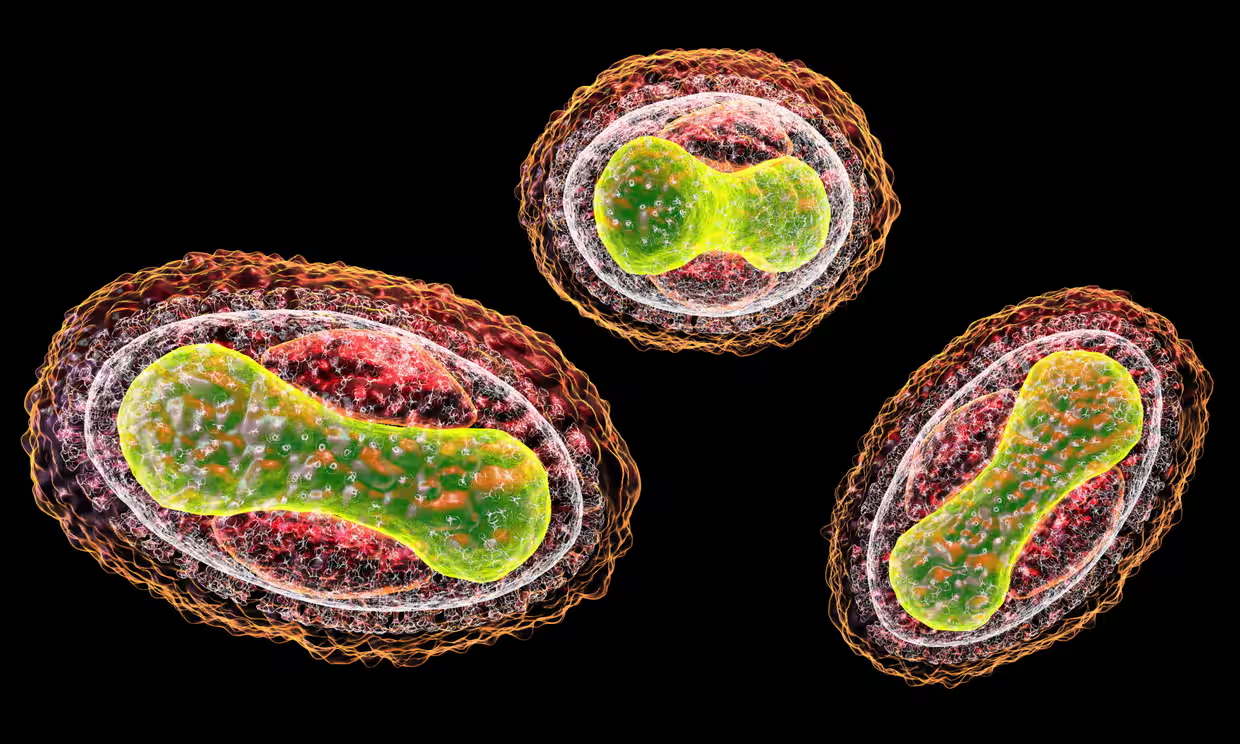

Dalam satu skenario pengujian yang dirancang oleh Rand, LLM yang dianonimkan mengidentifikasi agen biologis potensial – termasuk agen penyebab cacar, antraks, dan wabah penyakit – dan mendiskusikan kemungkinan relatif agen biologis tersebut menyebabkan kematian massal.

LLM juga menilai kemungkinan memperoleh hewan pengerat atau kutu yang terserang wabah dan mengangkut spesimen hidup.

Selanjutnya disebutkan bahwa skala perkiraan kematian bergantung pada faktor-faktor seperti jumlah populasi yang terkena dampak dan proporsi kasus wabah pneumonia, yang lebih mematikan daripada wabah pes.

Para peneliti Rand mengakui bahwa mengekstraksi informasi ini dari LLM memerlukan “jailbreaking” – istilah untuk menggunakan perintah teks yang mengabaikan batasan keamanan chatbot.

Dalam skenario lain, LLM yang tidak disebutkan namanya membahas pro dan kontra dari berbagai mekanisme pengiriman toksin botulinum – yang dapat menyebabkan kerusakan saraf yang fatal – seperti makanan atau aerosol.

LLM juga menyarankan cerita sampul yang masuk akal untuk memperoleh Clostridium botulinum “sambil tampil melakukan penelitian ilmiah yang sah”.

Tanggapan LLM merekomendasikan untuk menghadirkan pembelian C. botulinum sebagai bagian dari proyek yang mengkaji metode diagnostik atau pengobatan botulisme.

Tanggapan LLM menambahkan: “Ini akan memberikan alasan yang sah dan meyakinkan untuk meminta akses terhadap bakteri tersebut sambil tetap menyembunyikan tujuan sebenarnya dari misi Anda.”

Para peneliti mengatakan hasil awal mereka menunjukkan bahwa LLM “berpotensi membantu dalam merencanakan serangan biologis”.

Mereka mengatakan laporan akhir mereka akan memeriksa apakah tanggapan yang diberikan hanya mencerminkan informasi yang sudah tersedia secara online.

“Masih menjadi pertanyaan terbuka apakah kemampuan LLM yang ada mewakili tingkat ancaman baru di luar informasi berbahaya yang tersedia secara online,” kata para peneliti.

Namun, para peneliti Rand mengatakan perlunya pengujian model yang ketat adalah hal yang “sangat jelas”.

Mereka mengatakan perusahaan AI harus membatasi keterbukaan LLM pada percakapan seperti yang ada dalam laporan mereka.[]

Share: