Ilustrasi: Apple.com

Ilustrasi: Apple.com

Cyberthreat.id - Apple mengumumkan di situsnya bahwa perusahaan akan memindai galeri foto di iPhone orang Amerika untuk mencari gambar pelecehan seksual anak. Meski mendapat pujian dari kelompok perlindungan anak, bagi pegiat privasi langkah itu berpotensi disalahgunakan jika diterapkan.

Perusahaan juga akan memeriksa isi pesan terenkripsi ujung ke ujung untuk pertama kalinya.

Alat Apple, yang disebut neuralMatch, akan memindai gambar sebelum diunggah ke penyimpanan online Foto iCloud, membandingkannya dengan database gambar pelecehan anak yang diketahui. Jika ditemukan kecocokan, maka staf Apple akan dapat meninjau gambar yang dilaporkan secara manual, dan, jika pelecehan anak dikonfirmasi, akun pengguna akan dinonaktifkan dan pemberitahuan dikirim ke Pusat Nasional untuk Anak Hilang dan Tereksploitasi (NCMEC).

Karena alat ini hanya mencari gambar yang sudah ada di database NCMEC, orang tua yang mengambil foto anak di kamar mandi, misalnya, tampaknya tidak perlu khawatir. Tetapi para peneliti khawatir alat pencocokan – yang tidak “melihat” gambar, hanya sidik jari matematis yang mewakilinya – dapat digunakan untuk tujuan yang berbeda.

Matthew Green, seorang peneliti kriptografi di Universitas Johns Hopkins, memperingatkan lewat Twitter, secara teoritis sistem dapat digunakan untuk menjebak orang yang tidak bersalah dengan mengirimkan gambar yang tampaknya tidak berbahaya yang dirancang untuk memicu kecocokan dengan gambar pelecehan anak.

“Para peneliti telah mampu melakukan ini dengan cukup mudah,” katanya tentang kemampuan untuk mengelabui sistem seperti itu, seperti dilansir The Guardian, Jumat (6 Agustus 2021).

Potensi pelanggaran lainnya dapat mencakup pengawasan pemerintah terhadap para pembangkang atau pengunjuk rasa.

"Apa yang terjadi ketika pemerintah China mengatakan: 'Ini adalah daftar file yang kami ingin Anda pindai,'" tanya Green. “Apakah Apple mengatakan tidak? Saya harap mereka mengatakan tidak, tetapi teknologi mereka tidak akan mengatakan tidak.”

Apple memang mengatakan teknologi itu baru akan diterapkan di Amerika Serikat. Namun, pengalaman sebelumnya, sebuah uji coba yang dianggap sukses di satu tempat, besar kemungkinan untuk diterapkan secara global.

Perusahaan teknologi termasuk Microsoft, Google dan Facebook telah bertahun-tahun berbagi jejak digital gambar pelecehan seksual anak yang diketahui. Apple telah menggunakannya untuk memindai file pengguna yang disimpan di layanan iCloud untuk gambar pelecehan anak. Tetapi keputusan Apple untuk memindahkan pemindaian langsung pada perangkat pribadi seseorang, belum pernah terjadi sebelumnya di perusahaan teknologi besar. Logikanya, iCloud atau Google Drive adalah properti perusahaan sehingga sah-sah saja jika mereka memindainya. Namun, perangkat iPhone di tangan pengguna adalah privasi penggunanya.

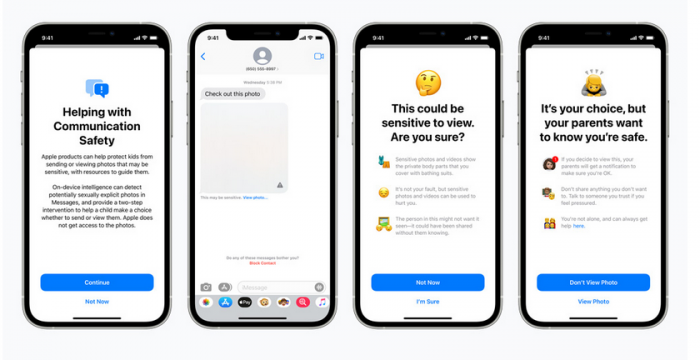

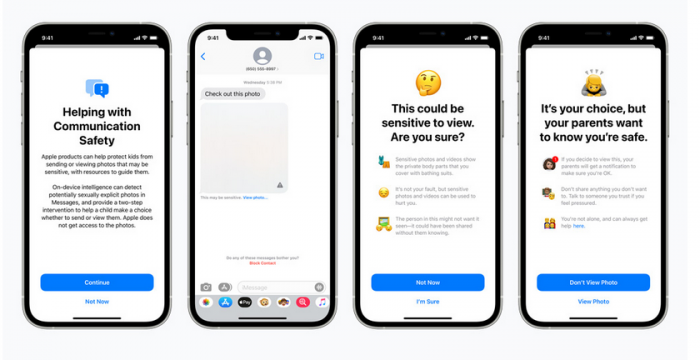

Bersamaan dengan teknologi neuralMatch, Apple berencana untuk memindai pesan terenkripsi pengguna saat dikirim dan diterima menggunakan iMessage. Alat berbasis AI akan mencoba mengidentifikasi gambar seksual eksplisit secara otomatis, memungkinkan orang tua untuk mengaktifkan filter otomatis untuk kotak masuk anak-anak mereka.

Sistem itu, yang murni ditujukan untuk menyediakan alat untuk "memperingatkan anak-anak dan orang tua mereka saat menerima atau mengirim foto seksual eksplisit", tidak akan menghasilkan gambar seksual eksplisit yang dikirim ke Apple atau dilaporkan ke pihak berwenang. Tetapi orang tua akan diberi tahu jika anak mereka memutuskan untuk mengirim atau menerima foto seksual vulgar.

Apple telah berada di bawah tekanan pemerintah selama bertahun-tahun terkait akses ke data terenkripsi. Muncul dengan langkah-langkah keamanan baru mengharuskan Apple untuk melakukan tindakan penyeimbangan yang halus antara menindak eksploitasi anak-anak sambil menjaga komitmen untuk melindungi privasi penggunanya.

Namun Electronic Frontier Foundation, pelopor kebebasan sipil online, menyebut kompromi Apple pada perlindungan privasi sebagai "hal yang mengejutkan bagi pengguna yang mengandalkan kepemimpinan perusahaan dalam privasi dan keamanan".

Ilmuwan komputer yang lebih dari satu dekade lalu menemukan PhotoDNA, teknologi yang digunakan oleh penegak hukum untuk mengidentifikasi gambar pelecehan anak secara online, mengakui potensi penyalahgunaan sistem Apple tetapi mengatakan itu jauh lebih penting daripada keharusan menangani pelecehan seksual anak.

"Apa itu mungkin? Tentu saja. Tapi apakah itu sesuatu yang saya khawatirkan? Tidak,” kata Hany Farid, seorang peneliti di University of California, Berkeley, yang berpendapat bahwa banyak program lain yang dirancang untuk mengamankan perangkat dari berbagai ancaman tidak terpengaruh oleh “jenis misi aneh ini”.

Sebagai contoh, WhatsApp menyediakan enkripsi ujung ke ujung untuk melindungi privasi penggunanya, tetapi juga menggunakan sistem untuk mendeteksi malware dan memperingatkan pengguna untuk tidak mengklik tautan berbahaya.

Apple adalah salah satu perusahaan besar pertama yang menerapkan enkripsi ujung ke ujung, di mana pesan diacak sehingga hanya pengirim dan penerima yang dapat membacanya.

Penegak hukum telah lama menekan perusahaan agar diberi akses khusus ke informasi tersebut. Apple mengatakan perubahan terbaru akan diluncurkan tahun ini sebagai bagian dari pembaruan sistem operasinya untuk iPhone, Mac, dan Apple Watch.

“Perlindungan Apple yang diperluas untuk anak-anak adalah pengubah permainan,” kata John Clark, presiden dan kepala eksekutif NCMEC. “Dengan begitu banyak orang yang menggunakan produk Apple, langkah-langkah keamanan baru ini berpotensi menyelamatkan nyawa anak-anak.”

Apple membantah perubahan tersebut merupakan pintu belakang yang menurunkan enkripsinya. Dikatakan, mereka sangat hati-hati mempertimbangkan inovasi yang tidak mengganggu privasi pengguna melainkan melindunginya.

"Di Apple, tujuan kami adalah menciptakan teknologi yang memberdayakan orang dan memperkaya hidup mereka - sambil membantu mereka tetap aman," kata perusahaan itu dalam sebuah posting yang mengumumkan fitur-fitur baru.

“Kami ingin membantu melindungi anak-anak dari predator yang menggunakan alat komunikasi untuk merekrut dan mengeksploitasi mereka, dan membatasi penyebaran materi pelecehan seksual anak (CSAM).

“Program ini ambisius, dan melindungi anak-anak adalah tanggung jawab penting. Upaya ini akan berkembang dan berkembang seiring waktu,” tambah Apple.[]

Share: